- 기억하는 챗봇 시대, 우리가 주의해야 할 점

인공지능(AI) 개발업체 오픈AI가 사용자와의 기존 대화를 기억했다가 다음 대화 때 활용할 수 있는 새로운 버전의 챗GPT를 출시했다.

14일(이하 현지시간) 더 버지에 따르면 챗GPT의 '기억' 기능은 과거 대화 기록을 기반으로 사용자를 인식하고 맞춤형 응답을 제공하여 챗봇 경험을 한층 더 개인화하고 자연스럽게 만들어지만 이와 동시에 개인 정보 침해에 대한 우려도 함께 불러일으키고 있다.

오픈AI는 13일 블로그 게시물을 통해 챗GPT 이용자가 대화 속 특정 정보를 기억하도록 하거나 챗GPT가 자체적으로 어떤 내용을 기억할지 정할 수 있는 옵션을 테스트 중이라고 발표했다.

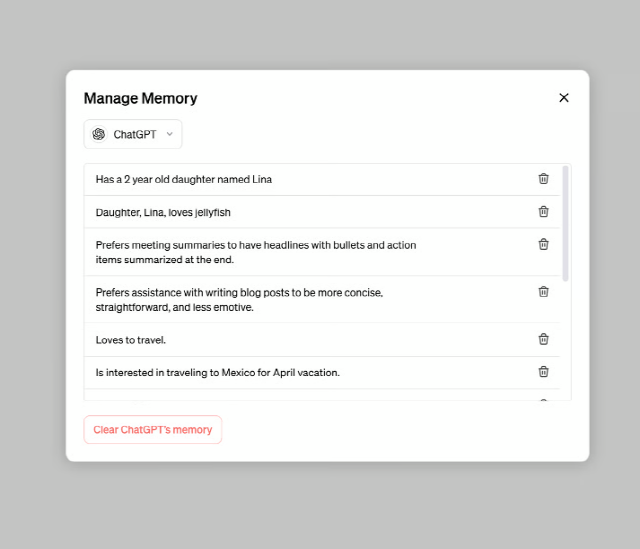

기억 기능의 추가로 챗GPT는 과거 대화를 기반으로 사용자를 인식하고 개인화된 경험을 제공할 수 있게 되었으며 대화 맥락을 이해해 더욱 자연스럽고 적절한 응답을 제공한다.

또한 과거 정보와 현재 질문을 연관하여 사용자의 의도를 더 정확하게 파악하고 동일한 정보를 반복적으로 제공할 필요가 없어 시간이 절약되고 사용자의 필요를 더 빠르고 정확하게 파악하여 교육, 여행, 건강 등 다양한 분야에서 사용자에게 맞춤형 서비스 제공 등으로 기능이 향상됐다.

개인의 경험을 기반으로 하기 때문에 공부하는 학생들에게는 개개인의 학습 진행 상황에 맞춘 맞춤형 학습 계획 제공 할 수 있으며 사용자 선호도를 반영한 여행 계획 추천 및 예약이 가능하며 건강 상태 및 운동 기록 추적을 통한 건강 관리 지원도 가능해졌다.

오픈AI 측은 우선 유료·무료 이용자 가운데 수십만명을 대상으로 테스트 후 적용을 확대할 계획이다. 샘 올트먼 CEO는 챗GPT 주간 이용자 수가 약 1억명 수준이라고 지난해 11월 밝히기도 했다.

하지만 기억 기능은 동시에 프라이버시 침해에 대한 우려를 낳고 있다. 사용자 개인의 민감한 정보가 유출될 수 있다는 것. 오픈AI는 사용자의 동의 없이 데이터를 모델 훈련에 사용할 수 있으며 챗봇이 사용자의 정보를 기억하고 활용하는 것은 윤리적인 논쟁을 불러일으키고 있다.

이런 다양한 문제를 방지하기 위해 오픈AI는 이용자에게 기억 기능을 제어할 수 있는 권한을 부여해 이용자들은 저장된 개인 정보를 삭제할 수 있으며, 어떤 내용을 기억하는지 챗GPT에 설명을 요청할 수 있다. 또 해당 기능 이용을 완전히 중단할 수도 있다.

일리야 슈츠케버(Ilya Sutskever) 오픈AI의 공동 설립자이자 최고 기술 책임자(CTO)는 기억 기능이 개인화와 프라이버시 사이의 균형을 유지하면서 챗봇 경험을 향상시킬 것이라며 사용자에게 데이터 사용에 대한 최종적인 제어 권한을 부여했으며 기술 개발 시 윤리적 책임을 고려한다고 말했다.

챗GPT의 기억 기능은 챗봇 경험을 개인화하고 향상시킬 수 있는 잠재력을 가지고 있지만, 동시에 개인 정보 침해와 윤리적 문제에 대한 우려를 동반한다. 오픈AI는 사용자에게 기억 기능을 제어할 수 있는 권한을 부여하고 투명성을 강화하는 등 노력을 기울이고 있지만, 지속적인 논의와 사회적 합의를 통해 윤리적 기준을 마련하고 사용자의 프라이버시를 보호할 수 있는 방안을 모색해야 할 필요가 있다.